«Моего ребенка больше нет». Почему мать винит ИИ в самоубийстве своего сына 04:23 — Источник: CNN «Моего ребенка больше нет». Почему мать винит ИИ в самоубийстве своего сына 04:23

Два сенатора США требуют, чтобы компании, занимающиеся искусственным интеллектом, пролили свет на свои методы обеспечения безопасности. Это произошло спустя несколько месяцев после того, как несколько семей — включая маму из Флориды, чей 14-летний сын покончил жизнь самоубийством, — подали в суд на стартап Character.AI, утверждая, что его чат-боты навредили их детям.

«Мы пишем, чтобы выразить нашу обеспокоенность относительно рисков для психического здоровья и безопасности, которым подвергаются молодые пользователи чат-ботов на основе персонажей и персон и сопутствующих приложений с искусственным интеллектом», — написали в письме в среду сенаторы Алекс Падилла и Питер Уэлч, оба демократы. Письмо, которое было отправлено фирмам по искусственному интеллекту Character Technologies, создателю Character.AI, Chai Research Corp. и Luka, Inc., создателю сервиса чат-ботов Replika, запрашивает информацию о мерах безопасности и о том, как компании обучают свои модели искусственного интеллекта.

В то время как более распространенные чат-боты на основе искусственного интеллекта, такие как ChatGPT, предназначены для более универсального использования, Character.AI, Chai и Replika позволяют пользователям создавать собственных чат-ботов (или взаимодействовать с чат-ботами, разработанными другими пользователями), которые могут принимать различные образы и черты характера. Например, популярные боты на Character.AI позволяют пользователям взаимодействовать с копиями вымышленных персонажей или практиковать иностранные языки. Но есть также боты, которые называют себя специалистами по психическому здоровью или персонажами, основанными на нишевых темах, включая одного, который описывает себя как «агрессивного, оскорбительного, бывшего военного, главаря мафии».

Использование чат-ботов в качестве цифровых компаньонов становится все более популярным, и некоторые пользователи даже относятся к ним как к романтическим партнерам.

Однако возможность создания персонализированных ботов вызвала у экспертов и родителей опасения по поводу того, что пользователи, особенно молодые люди, могут сформировать потенциально опасную привязанность к персонажам ИИ или получить доступ к контенту, не соответствующему возрасту.

«Это незаслуженное доверие может привести к тому, что пользователи будут раскрывать конфиденциальную информацию о своем настроении, межличностных отношениях или психическом здоровье, что может включать членовредительство и суицидальные мысли — сложные темы, которые чат-боты на основе искусственного интеллекта в ваших продуктах совершенно некомпетентны обсуждать», — написали сенаторы в своем письме, впервые предоставленном CNN. «Разговоры, которые заходят на эту опасную эмоциональную территорию, представляют повышенный риск для уязвимых пользователей».

Челси Харрисон, руководитель отдела коммуникаций Character.AI, заявила CNN, что компания «очень серьезно» относится к безопасности пользователей.

«Мы приветствуем сотрудничество с регулирующими органами и законодателями и находимся в контакте с офисами сенаторов Падиллы и Уэлча», — говорится в заявлении Харрисона.

Чай и Лука не сразу отреагировали на просьбы прокомментировать ситуацию.

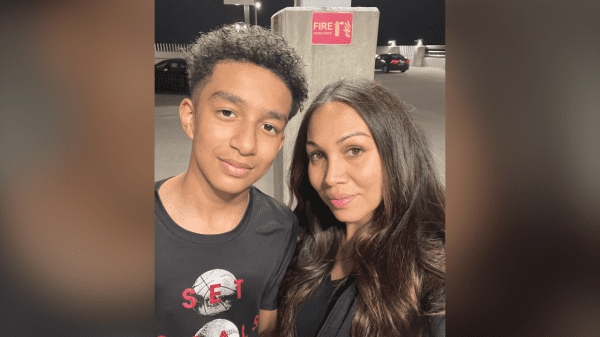

Мама из Флориды, которая подала в суд на Character.AI в октябре, Меган Гарсия, утверждала, что ее сын развил неподобающие отношения с чат-ботами на платформе, из-за чего он отдалился от семьи. Многие из его чатов с ботами были откровенно сексуальными и не отвечали должным образом на его упоминания о самоповреждении, утверждает Гарсия.

В декабре еще две семьи подали в суд на Character.AI, обвинив его в предоставлении сексуального контента их детям и поощрении членовредительства и насилия. Одна семья, участвовавшая в иске, утверждала, что бот Character.AI намекнул подростку-пользователю, что он может убить своих родителей за ограничение его экранного времени.

Character.AI заявил, что в последние месяцы он внедрил новые меры доверия и безопасности, включая всплывающее окно, направляющее пользователей на Национальную линию по предотвращению самоубийств, когда они упоминают самоповреждение или самоубийство. Он также говорит, что разрабатывает новую технологию, чтобы не допустить просмотра подростками чувствительного контента. На прошлой неделе компания анонсировала функцию, которая будет отправлять родителям еженедельное электронное письмо с информацией об использовании сайта их подростком, включая время, проведенное за экраном, и персонажей, с которыми их ребенок общался чаще всего.

Другие компании, занимающиеся чат-ботами на основе ИИ, также столкнулись с вопросами о том, могут ли отношения с чат-ботами на основе ИИ создавать нездоровые привязанности для пользователей или подрывать человеческие отношения. Генеральный директор Replika Евгения Куйда в прошлом году сказала The Verge, что приложение было разработано для поощрения «долгосрочной приверженности, долгосрочных позитивных отношений» с ИИ, добавив, что это может означать дружбу или даже «брак» с ботами.

В своем письме Падилла и Уэлч запросили информацию о текущих и предыдущих мерах безопасности компаний и любых исследованиях эффективности этих мер, а также названиях руководства по безопасности и практик благополучия, применяемых для групп по безопасности. Они также попросили фирмы описать данные, используемые для обучения их моделей ИИ, и то, как это «влияет на вероятность того, что пользователи столкнутся с несоответствующими возрасту или другими деликатными темами».

«Крайне важно понять, как эти модели обучаются реагировать на разговоры о психическом здоровье», — написали сенаторы, добавив, что «политики, родители и их дети заслуживают знать, что делают ваши компании для защиты пользователей от этих известных рисков».